社区微信群开通啦,扫一扫抢先加入社区官方微信群

社区微信群

社区微信群开通啦,扫一扫抢先加入社区官方微信群

社区微信群

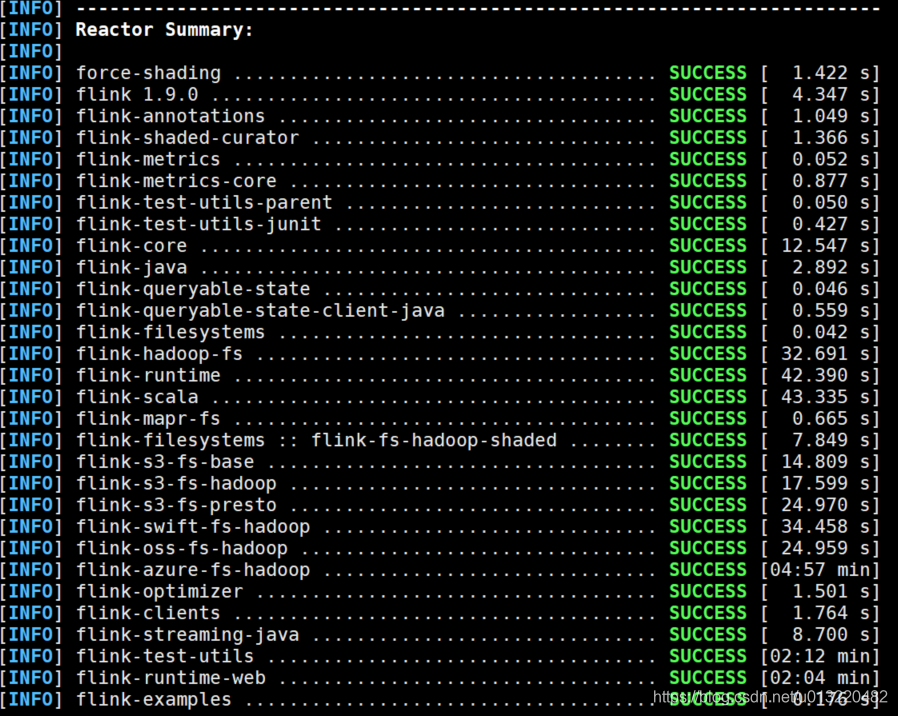

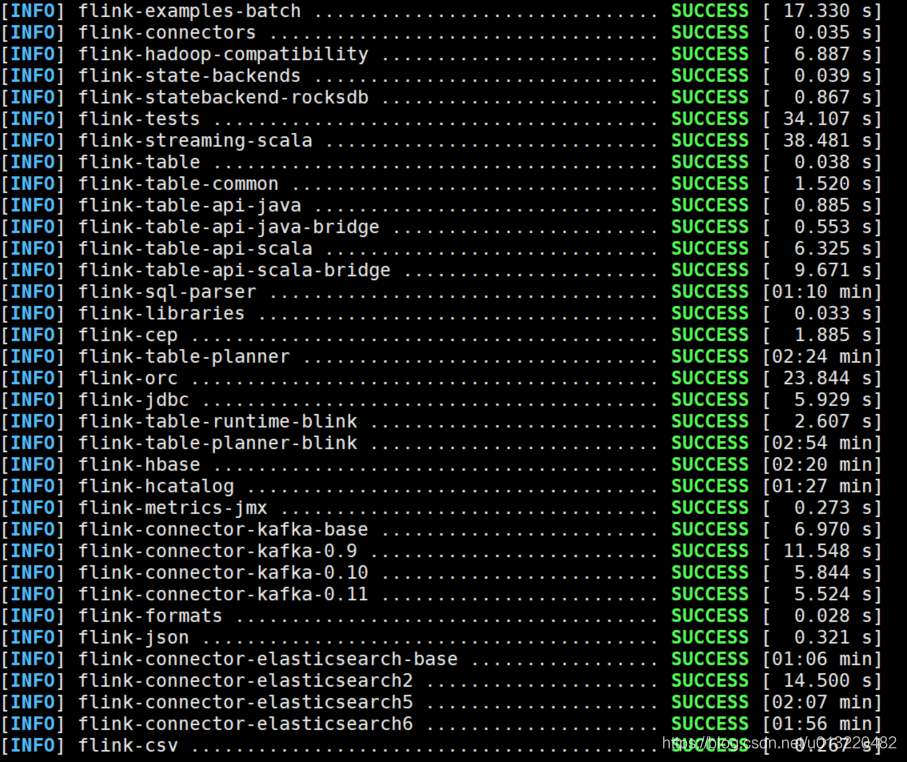

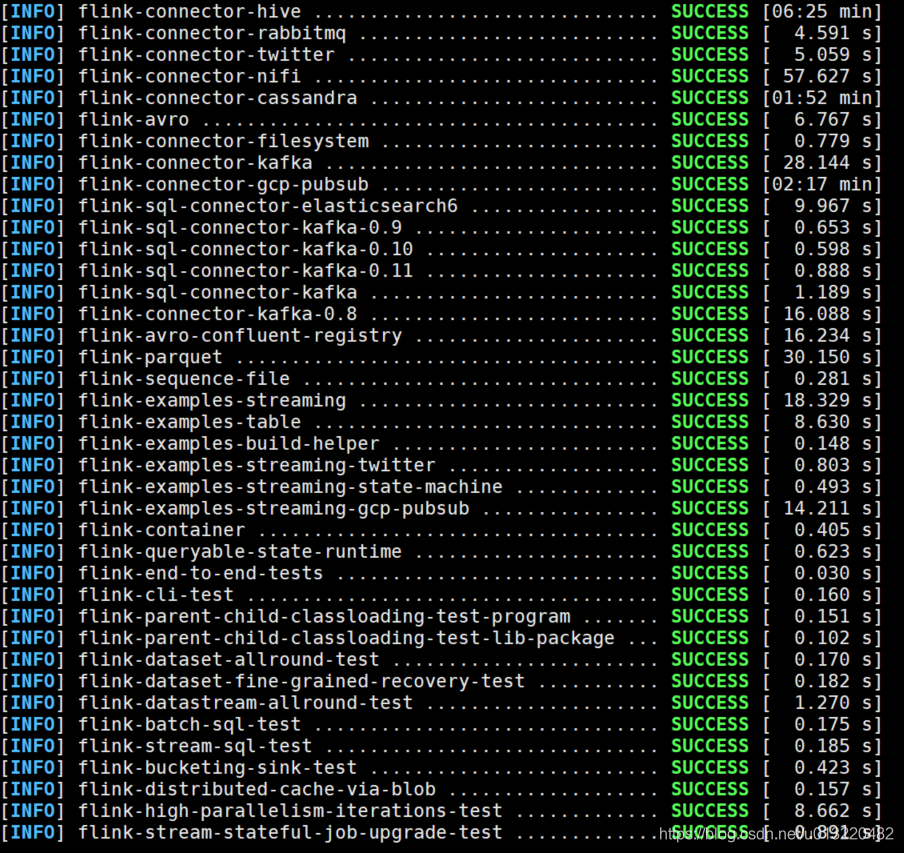

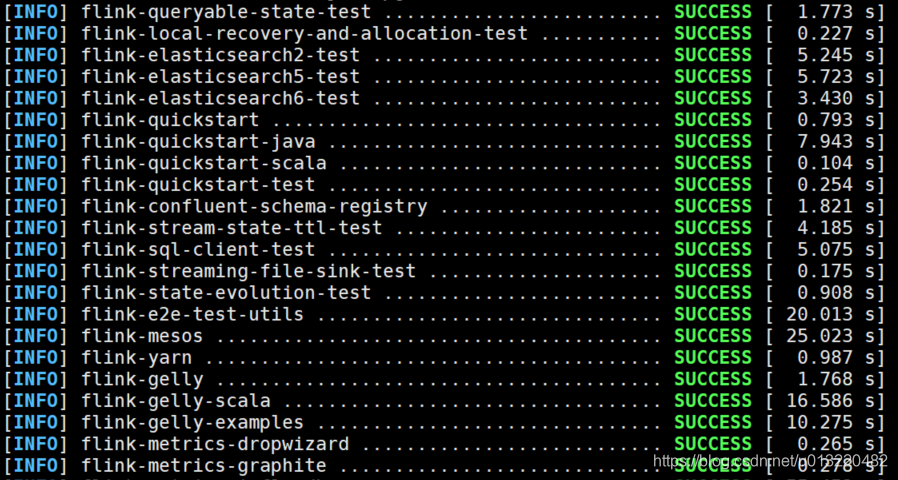

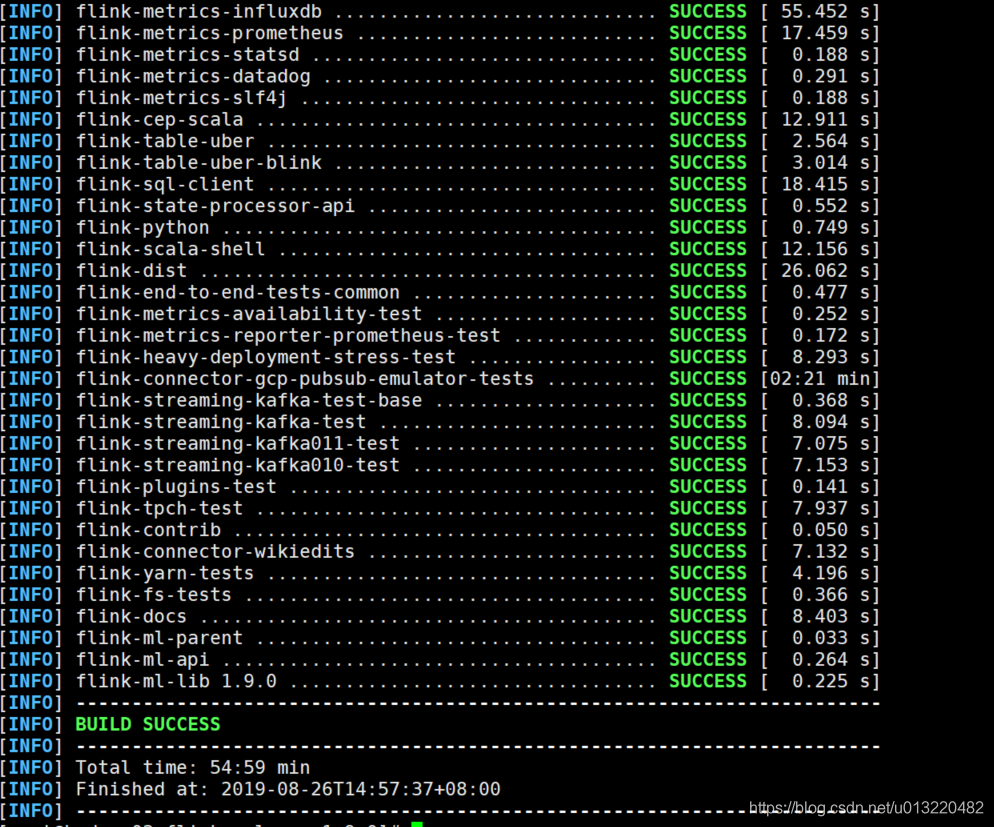

Flink1.9发布,你是否很想用?可是你的hadoop版本是cdh版本,没法编译成功怎么办?按照这篇文章,你会一次性的完成源码编译的工作!!!

在阿里开源并贡献Blink至社区以后,大家都在等待社区版和Blink版本什么时候能merge到一起,让劳苦大众也体验一把飞翔的感觉!终于,它来啦,就在2019年8月,Flink社区发布了1.9版本,据说更改了150万行代码,所以毫无犹豫直接把Flink1.9使用到公司的项目中!

登录github的flink项目:Flink1.9 release版本

wget https://github.com/apache/flink/archive/release-1.9.0.zip

unzip release-1.9.0.zip -d ./

mvn -v

<repositories>

<repository>

<id>cloudera</id>

<url>https://repository.cloudera.com/artifactory/cloudera-repos/</url>

</repository>

</repositories>

<repository>

<id>mvnrepository</id>

<url>https://mvnrepository.com</url>

</repository>

<mirror>

<id>nexus-aliyun</id>

<mirrorOf>*,!cloudera,!mvnrepository</mirrorOf>

<name>Nexus aliyun</name>

<url>http://maven.aliyun.com/nexus/content/groups/public</url>

</mirror>

wget https://archive.apache.org/dist/flink/flink-shaded-7.0/flink-shaded-7.0-src.tgz

<repositories>

<repository>

<id>cloudera</id>

<url>https://repository.cloudera.com/artifactory/cloudera-repos/</url>

</repository>

</repositories>

mvn clean install -DskipTests -Dhadoop.version=2.6.0-cdh5.14.2

hadoop version

mvn clean install -DskipTests -Pvendor-repos -Dhadoop.version=2.6.0-cdh5.14.2 -Dmaven.javadoc.skip=true -Dcheckstyle.skip=true

如果觉得我的文章对您有用,请随意打赏。你的支持将鼓励我继续创作!